“Digite e receberás”. Esta é a premissa básica dos programas de Inteligência Artificial (IA) que transformam textos em imagens.

O usuário digita uma descrição de qualquer coisa que deseje — um Joe Biden ciborgue punhando uma espada samurai; uma tapeçaria medieval de sapos em justas — e esses sitemas, treinados por gigantescas bases de dados de artes existentes, geram imagens inéditas que (mais ou menos) representem esses inputs (mais ou menos).

E, mesmo com os resultados dos modelos atuais com certeza não sendo perfeitos, para esse nicho de entusiastas tecnológicos, tais falhas soam insignificantes quando comparadas ao potencial desses softwares capazes de desenhar o que você for capaz de imaginar.

Até o momento presente, contudo, essas ferramentas “digite e receberás” vem sido controladas por um numero reduzido de companhias com alto nível de recursos como OpenAI (que construiu o DALL-E) e google (que fez o Imagen). Esses são grandes players com muito a perder, logo, eles balancearam as possibilidades do que esta tecnologia pode fazer com o que a reputação das suas companhias permite.

Então, para um modelo como DALL-E, acesso público é dado em migalhas através de uma longa lista de espera, enquanto o Imagen da Google está totalmente fora do alcance do público geral. Os resultados do DALL-E também são filtrados, tornando mais difícil gerar imagens que contenham violência, nudez ou faces realistas. E, claro, você tem que pagar. O usuários do DALL-E recebem prompts de 15 imagens mensalmente, com gerações adicionais custando por volta de US$ 0,08 por figura. Não chega a ser caro mas, ainda assim, é uma barreira.

Nas últimas semanas, entretanto, o status quo tem sido elevado por um novo player no cenário: um programa de criação baseada em texto-para-imagem chamado Stable Diffusion que oferece open-source, geração sem filtros que é gratuito para uso de qualquer um que tenha um computador decente e um cadinho a mais de conhecimento técnico. O modelo foi lançado publicamente apenas em 22 de Agosto mas em pouco tempo sua influência já se espalhou, quieta e rapidamente. Tem sido abraçado pela comunidade de arte IA e criticado por muitos artistas tradicionais: tem sido separado, exatado e preocupado.

“A realidade é que isto é uma tecnologia alienígena que permite superpoderes”. Emad Mostaque, CEO da empresa mãe da Stable Diffusion, Stability AI, contou em entrevsita. “Nós vimos desde crianças de 3 anos a adultos de 90 anos serem capazes de criar pela primeira vez. Mas também vimos pessoas criando coisas impressionantemente odiáveis”.

O que faz a Stable Diffusion diferente?

O diferencial chave entre a Stable Diffusion e outros geradores de arte IA é o foco em open source. Mesmo o Midjourney — outro modelo de texto-para-imagem que está sendo construído fora do complexo da Big Tech — não oferece um acesso tão compreensivo ao seu software.

A companhia por trás de Stable Diffusion, Stability AI, embrulhou essa tecnologia de várias formas. Tem um demo público que qualquer um pode testar (apesar de ser extremamente lento e frequentemente dar erro). Há um software beta que é rápido e fácil de usar chamado DreamStudio (mas te cobra após um certo número de imagens geradas). E, mais significantemente, tem uma versão completa do modelo que qualquer um pode baixar de mexer com ela. Desenvolvedores terceiros já vem fazendo esse software mais fácil de fazer download e usar. Já há uma versão para macOS que vem com um instalador de um 1 único clique, por exemplo (embora, esteja avisado — leva um longo tempo para gerar imagens em qualquer Mac sem um sério grunhido de processamento).

É essa liberdade que Mostaque diz que permitirá Stable Diffusion a melhorar mais rapidamente que seus rivais. Se você checar o subreddit do Stable Diffusion, por exemplo, você pode ver usuários não somente compartilhando suas favoritas prompts de imagens (por exemplo, “McDonalds no período Edo do Japão” e “Bernie Sanders em um filme Mad Max que não existe“) mas criando novos usos para o programa e integrando estes a ferramentas criativas já estabelecidas.

No exemplo abaixo, um usuário criou um plug-in para o Photoshop que usa Stable Diffusion para pintar sobre seus rabiscos rudimentares. Eles começam comimagens de uma colina japonesa arborizada, então esboça onde a grama, árvores e céu deveria ir. Stable Diffusion então preenche os espaços vazios e o usuário limpa as junções manualmente. Como um Redditor comentou abaixo do post: “Estou estonteado por todos os impressionantes projetos surgindo e não tem nem uma semana desde o lançamento. O mundo será um lugar totalmente diferente em 6 meses”.

Na explicação de Mostaque, open source é sobre “colocar isto nas mãos de gente que vai construir e estender essa tecnologia”. Contudo, isso signfica por TODAS essas capacidades nas mãos do público — e lidar com as consequências, boas e ruins.

Sem chance, sem filtro?

A diferença mais dramática para a abordagem open source da Stability AI é estar hands-off na moderação. Diferente de na DALL-E, é fácil usar o modelo para gerar imagens de cunho violento ou sexual; que mostrem figuras públicas ou celebridades; ou que se assemelhe a imagens com copyright, desde o trabalho de pequenos artistas a mascotes de grandes corporações (Compreender exatamente o quão amplo o escopo de imagens Stable Diffusion pode gerar é difícil, mas se você quiser ter uma ideia, tente digitar alguns termos no Lexica, um mecanismo de busca que raspa imagens geradas usando Stable Diffusion).

Para ser claro: versões do Stable Diffusion mais amistosas aos consumidores tem alguns filtros de palavra já de stock para impedir usuários de gerar conteúdo NSFW (não apropriado para o trabalho), e abertamente político ou violento (palavras como “nazi” e “gore” são banidas, por exemplo). Mas, ao mesmo tempo que essas restrições também existem no modelo “baixável”, isso pode ser burlado fácilmente (veja, por exemplo, um post no subreddit do Stable Diffusion titulado “como remover o filtro de segurança em 5 segundos“).

Semelhantemente, enquanto a licença do modelo open source proíbe pessoas de usar o software para toda uma gama de pecados (incluindo “ploração, dano ou atentado de exploração de menores em qualquer forma” e “gerar ou disseminar informação falsa verificável”), uma vez que alguém baixe Stable Diffusion para o seu computador, não há restrições técnicas à maneira que eles possam vir a usar o software.

A visão de Mostaque é bem direta. “No final das contas, é responsabilidade das pessoas se elas serão éticas, morais, legais e como elas operarão esta tecnologia.”ele disse. “As coisas ruins que as pessoas criarem com isso […] eu acho que será uma porcentagem muito, muito pequena do total dos usos”.

Este é essencialmente um território não mapeado, não é claro o que serão as consequências do lançamento de um modelo como esse sendo lançado para a “selva”. É fácil imaginar o que os muitos usos maliciosos dessa tecnologia poderiam ser, mas isso não quer dizer que essas predições chegarão a se concretizar.

Por exemplo, quando OpenAI estreou seu gerador de texto baseado em IA GPT-3, a companhia inicialmente limitou o acesso por temores de que o software pode ser usado para criar um dilúvio de spam, fake news e propaganda. Até agora, contudo, essas ameaças tem se provado um exagero. Conforme o acesso tem se ampliado, o dilúvio não tem surgido. Isto não quer dizer que não tenham ocorrido sérios problemas com a tecnologia (veja, por exemplo, o caso da AI Dungeon, um jogo textual de fantasia baseado em GPT-3 que precisou introduzir filtros para impedir o software de gerar cenas sexuais envolvendo menores), mas um cataclisma de infinito de spam, discurso de ódio, etc, gerado por IA tem sido evitado (não coincidentemente, Stability AI também ajudou a fazer uma versão open source do GPT-3).

Com Stable Diffusion, o mais aparente caso de uso gerando NSFW tem sido usuários criando pornografia. Após o lançamento público do modelo, um número de subreddits dedicados a curar os resultados NSFW que surgiram (apesar de que a maioria tem sido banida desde então devido a política do Reddit que proíbe deepfakes pornográficos. Muitos usuários estavamo gerando imagens de nudez de celebridades ou figuras públicas). Esse conteúdo NSFW frequentemente oscila entre o grotesco e o absurdo, com modelos nus portando membros adicionais e colocados em poses fisicamente impossíveis. Mas a qualidade desses resultados certamente melhorará em um futuro próximo, trazendo com isso novas perguntas sobre ética do pornô gerado por IA.

É quase certo, por exemplo, que Stable Diffusion pode ser usado para gerar imagens de teor sexual envolvendo crianças, apesar de que, se isto de fato está acontecendo, está provavelmente por cantos menos observados da web. Mostaque nota que este é um domínio de geração de imagem que a companhia tentou impedir através da remoção de material com abuso infantil da base de dados do treinamento da Stable Diffusion: “Nós removemos conteúdo ilegal da nossa parte da internet, é isto”.

De forma geral, contudo, a posição de Mostaque é que Stability AI não tem sido nem desatenciosa ou imprudente em seu lançamento da Stable Diffusion. Em contraste, ele diz que a companhia de efetivo aproximado de 75 pessoas considerou preparar mais filtros para o lançamento mas concluiu que sua abordagem open source era a melhor escolha, “Uma vez que você começa a filtrar algo, quando você para?”, disse ele.

Em última análise, a empresa está seguindo um dos mantras mais bem ensaiados (e frequentemente criticados) do setor: que a tecnologia é neutra e que construir coisas é melhor do que não. “Esta é a abordagem que adotamos porque vemos essas ferramentas como uma infraestrutura potencial para o avanço da humanidade”, diz Mostaque. “Achamos que os elementos positivos superam em muito os negativos”.

Copiando artistas e raspando copyrights

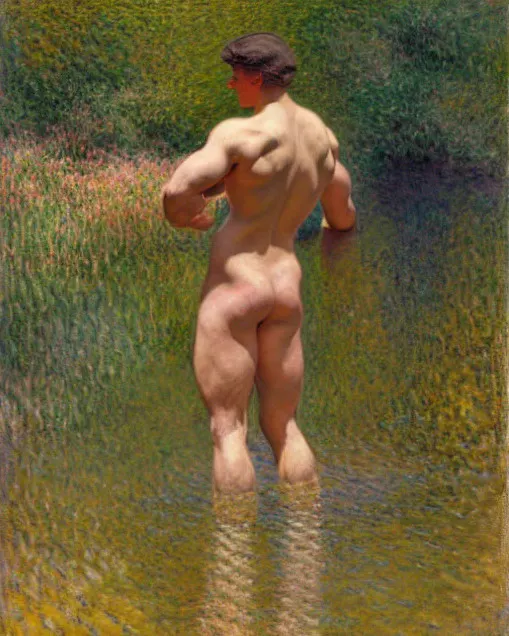

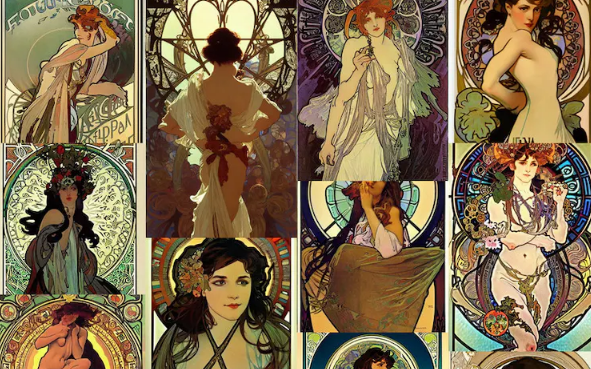

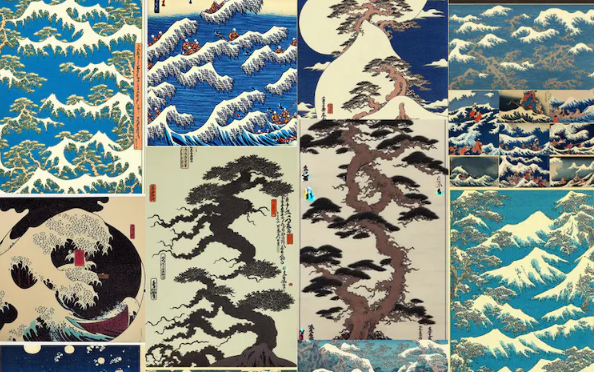

Um domínio visual que a Stability AI certamente não filtrou de seus dados de treinamento é o trabalho protegido por direitos autorais. Como resultado, muitos veem a capacidade do Stable Diffusion de imitar o estilo e a estética de artistas vivos como insustentável: não apenas uma violação potencial de direitos autorais, mas também de ética. Um tweet viral inicial criticando o software catalogou alguns dos muitos artistas vivos que o modelo pode imitar (embora alegasse falsamente que a Stability AI estava “anunciando” essa função).

Como a maioria dos sistemas modernos de IA, o Stable Diffusion é treinado em um vasto conjunto de dados que explora padrões e aprende a replicar. Nesse caso, esse núcleo dos dados de treinamento é um enorme pacote de mais de 5 bilhões de pares de imagens e tags de texto conhecido como LAION-5B, todos extraídos da web pública. (Vale a pena notar que, embora o LAION-5B seja mantido pela Stability AI, ele é derivado do trabalho da organização sem fins lucrativos Common Crawl, que economiza enormes resmas de páginas da Web e libera os dados gratuitamente para qualquer pessoa usar).

Sabemos com certeza que o LAION-5B contém muito conteúdo protegido por direitos autorais. Uma análise independente de uma amostra de 12 milhões do conjunto de dados descobriu que quase metade das fotos contidas foram tiradas de apenas 100 domínios. O mais popular foi o Pinterest, constituindo cerca de 8,5% das fotos amostradas, enquanto as próximas maiores fontes foram sites conhecidos por hospedar conteúdo gerado pelo usuário (como Flickr, DeviantArt e Tumblr) e sites de fotos como Getty Images e Shutterstock. Em outras palavras: fontes que contém conteúdo protegido por direitos autorais, sejam de artistas independentes ou fotógrafos profissionais.

Esse aspecto de direitos autorais adiciona uma nova dimensão às reclamações de que ferramentas como Stable Diffusion estão tirando o trabalho de artistas humanos. A IA não apenas está roubando os empregos dos artistas, dizem os críticos, mas está fazendo isso contrabandeando as habilidades que esses indivíduos levaram horas e horas para aprimorar.

“Alguns dos meus primeiros trabalhos freelance foram ilustrações de jogos de cartas, capas de livros e capas de álbuns. É de partir o coração ver esse espaço (especialmente o último) ser preenchido com imagens geradas por IA e perceber o quão mais difícil se tornou para aspirantes a artistas”, comentou diretor de arte Logan Preshaw em um recente tópico viral no Twitter sobre software de arte de IA. “Todos têm o direito de criar arte, mas não têm o direito de fazê-lo às custas dos outros”.

A resposta da Stability AI é novamente de neutralidade reivindicada. Mostaque diz que extrair material público da web – mesmo conteúdo protegido por direitos autorais – é legal nos EUA e no Reino Unido (embora isso não signifique que objeções legais não serão levantadas no futuro). Ele também argumenta que a natureza de código aberto do Stable Diffusion significa que ele e seus colegas não estão acumulando esses novos poderes, mas compartilhando-os amplamente para qualquer um usar.

“Como isso está sendo divulgado?” pergunta Mostaque. “Isso está criando um serviço em torno dele que mantemos privado, como o OpenAI? Este é um modelo de arte? Não, isso está sendo lançado por um instituto de pesquisa como um modelo generalizado, e cabe ao usuário final como usá-lo. Se o usarem de maneira que infrinja os direitos autorais, estão infringindo a lei” (Ao dizer que o modelo está sendo divulgado por um “instituto de pesquisa”, Mostaque está se referindo ao fato de que a licença técnica para difusão estável foi lançado pelo laboratório CompVis da Universidade Ludwig Maximilian de Munique, embora a Stability AI tenha financiado e moldado seu desenvolvimento.).

Mostaque diz que futuras iterações do Stable Diffusion darão aos artistas a opção de fazer upload de seus portfólios e nomes para filtrar sua influência da produção do modelo. Mas, assim como na geração de conteúdo NSFW, esses filtros serão opcionais para os usuários que baixarem a versão open-source do software. Em outras palavras: se os artistas tiverem problemas com geradores de arte de IA que imitam seu trabalho, é improvável que as soluções venham de empresas como a Stability AI.

(A galeria abaixo mostra as pesquisas da Stable Diffusion sobre alguns artistas nomeados.)

Tá na hora de um pouco de teoria do jogo

Tudo isso, entretanto, nos leva a outra pergunta interessante: o que é Stability AI e o que a companhia está tentando alcançar?

O próprio Mostaque é um ex-gerente de fundos de hedge que contribuiu com uma quantia desconhecida (mas aparentemente significativa) para financiar a criação da Stable Diffusion. Ele deu estimativas ligeiramente variadas quanto ao custo inicial do projeto, mas elas tendem a oscilar em torno de US$ 600.000 a US$ 750.000. É muito dinheiro – bem fora do alcance da maioria das instituições acadêmicas – mas uma quantia minúscula comparada com o valor imaginado do produto final. E Mostaque deixa claro que ele quer que a Stability AI ganhe muito dinheiro enquanto mantém seu ethos de código aberto, apontando para unicórnios de código aberto no mercado de banco de dados como comparação.

Ele também insiste, porém, que o dinheiro não é sua maior preocupação. Em vez disso, ele diz que quer alcançar algo mais parecido com uma revolução no mundo da IA: destronar os gigantes corporativos que estão construindo sistemas cada vez maiores e mais caros e substituí-los por comunidades mais inteligentes, rápidas e independentes.

“Vejo empresas e organizações como IA lenta e burra”, diz ele. “E quando falamos em sermos mortos pela IA se ficar muito inteligente, já estamos sendo mortos todos os dias pelas burocracias que realmente nos esmagam.” Liberar o Stable Diffusion como um projeto de código aberto é, em sua opinião, uma maneira de manobrar essas instituições desajeitadas. “Todo mundo está tornando [esses modelos de IA] privados até que a primeira pessoa os torne públicos. Do ponto de vista da teoria dos jogos, o que acontece quando alguém os torna públicos? Todo mundo vai a público. OpenAI e todos terão que se juntar às nossas comunidades e nossos ecossistemas”.

Forçar essa mudança não é apenas desenvolver a tecnologia mais rapidamente, diz Mostaque, mas espalhar esses sistemas globalmente. Em sua opinião, o mundo da IA está atualmente em um caminho para ser dominado pela cultura e ética do Vale do Silício, mas o software de código aberto pode ajudar a descentralizar esse futuro. No caso de ferramentas de geração de imagens, por exemplo, ele espera que diferentes nações desenvolvam seus próprios modelos e conjuntos de dados para “refletir a diversidade da humanidade” em vez da “monocultura da internet, que é predominantemente ocidental”.

É um grande objetivo, mas não menos do que sua descrição da Stable Diffusion como “trazer o fogo dos deuses da criatividade para o mundo”.

Agora, o mundo precisa descobrir como não se queimar.